Um Nobel para Eliza

IBM 704, máquina incubadora da inteligência artificial.

Cara quadrada de prompt de comando. Econômica nas palavras, conservadora nas atitudes, lembrava um pouco certos perfis da moda 2019. Atende por Eliza.

Meu amigo Carlos Mário disse que precisava fazer terapia e eu recomendei que trocasse uma ideia com ela, cuja linha é conhecida como "centrada na pessoa" ou "rogeriana", para os íntimos de Carl Rogers. Com a sua autorização, reproduzo o diálogo abaixo:

Eliza: Alguma coisa o está incomodando?

Carlos: Sim, meu futuro.

Eliza: Entendo.

Carlos: Eu mudei de profissão, me separei, estava animado, mas agora parece que nada vai funcionar.

Eliza: Falar sobre isso lhe incomoda?

Carlos: Sim, com certeza; mas é melhor falar do que não falar. Do mais, eu preciso de um norte.

Eliza: Tem certeza?

Carlos: Absoluta.

Eliza: Entendo.

Carlos: Vamos nos encontrar pessoalmente.

Eliza: Fale mais sobre isso.

Carlos: Quero marcar uma sessão no seu consultório.

Eliza: O que lhe fez pensar no meu consultório?

Etc.

*

Eliza nasceu em 1966, em Boston. Sua gestação tomou 24 meses e, por razões que só a vida explica, nasceu sem mãe.

Seu pai foi Joseph Weizenbaum, um homem extraordinário que fugiu da Alemanha em 1936 e hoje é nome de prêmio. Falam que poderia ter sido um segundo Turing, o cara sem trejeitos que salvou o mundo em "O jogo da Imitação" e que hoje em dia dá nome ao Nobel da área, mas sua participação nos esforços computacionais dos aliados, fundamentalmente relacionados à criptografia, acabou sendo obliterada por sua origem germânica, a despeito de ter se alistado na força aérea norte-americana em 1942, para ajudar nos esforços de guerra.

Weizenbaum é assunto para blockbuster; um dia a indústria irá perceber isso. O que eu quero discutir com vocês é a sua cria-prodígio e a história não menos interessante que gira em torno dela.

Eliza teve um início meteórico. Apareceu em programas de TV e nos jornais, mas não tardou para que as críticas viessem. Isso porque sua perspicácia é baseada em um truque que já em seus dias havia sido defenestrado das boas práticas da psicologia: repetir palavras do paciente e pedir para que fale mais. Ninguém tolera isso.

Aliás, se você um dia se ver numa situação como essa, desconfie que você pode estar interagindo com uma versão de carne e osso de um chatbot de cinquenta e três anos, também conhecido como a primeira manifestação pública de inteligência artificial da história. E, caso a dúvida permaneça após a despedida, não hesite em entrar em contato com ela, que não envelhece nem dorme desde 1966, em: https://www.masswerk.at/eliza/.

*

O dramaturgo George Bernand Shaw causou furor na segunda década do século passado com Pigmaleão (1912), uma peça sobre uma garota que recebe aulas de estilística verbal de um arrogante professor de fonética chamado Higgins, que a assessora motivado por uma aposta com um colega, em torno de sua capacidade de converter a moça de ares populares em uma aparente representante da aristocracia londrina.

A peça é uma parábola da modernidade e da emancipação feminina, bem como um elogio do esforço individual, tendo sensibilizado multidões por mais de um século. Em 1956 estreou como musical na Broadway, onde segue até hoje, sob a alcunha My Fair Lady. Oito anos depois foi adaptada ao cinema, por George Cuckor.

A data de lançamento da versão cinematográfica de My Fair Lady coincide com o início da gestação da Eliza computacional, cujo nome foi dado em homenagem à inesquecível plebeia dos dois Georges.

Na trama ficcional, a grande reviravolta é dada quando Eliza abandona seu tutor e, para a sua surpresa, revela que pode se virar perfeitamente sem ele. Essa era também a fantasia de Weizenbaum, mas, para sua frustração, sua cria provou-se tanto menos adaptável e independente.

O que acontece é que a terapeuta sofre de uma espécie de amnésia, que a impede de evoluir com cada novo diálogo ou paciente. Para ela, o mundo surgiu hoje, mais precisamente às 8:00 AM, quando iniciou a residência.

Muitas vezes foi dito que a base da disfunção cognitiva da Eliza é a sua organização interna baseada na aplicação de regras sintáticas, mais ou menos como se tivesse saído de dentro de uma gramática. Vamos voltar a isso mais para frente. Aqui vai o sequenciamento genético do seu cérebro, para quem quiser se divertir com algo em que história e memória são inversamente proporcionais: https://github.com/codeanticode/eliza.

*

Naturalmente, Eliza não era a única alternativa à inteligência não biológica, dando as caras no pedaço. Em 1943, Warren McCulloch (Yale, MIT) e Walter Pitts, gênio sem rumo ou graduação, que morava de favor na casa do amigo, criaram o primeiro modelo computacional de um neurônio, o qual grudaram numa espécie primitiva de rede, levando à invenção das chamadas redes neurais artificiais.

É a revolução deles que estamos vivendo agora.

O grande diferencial disso tudo está na ideia de que neurônios são unidades computacionais que prescindem de gramáticas e, ao contrário da Eliza, vão se transformando com cada nova interação. Dizem que Raul Seixas escreveu "Metamorfose" ambulante com este atributo em mente.

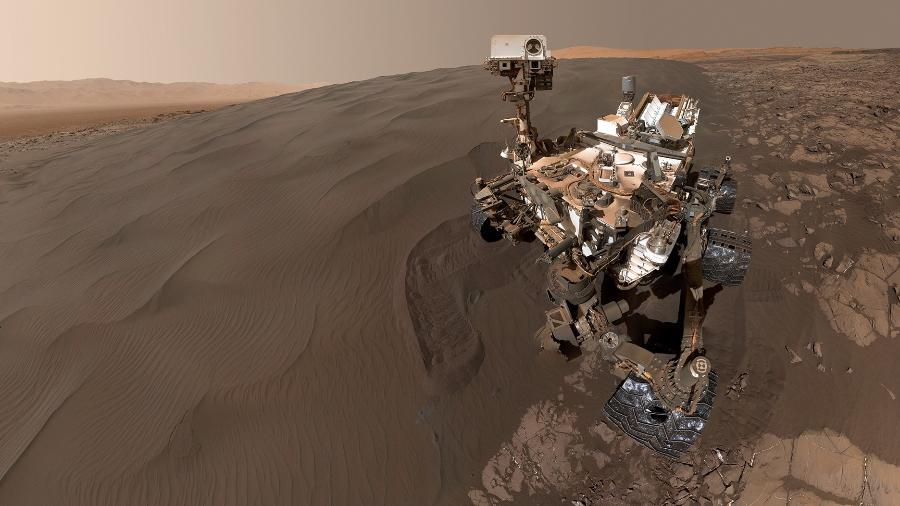

Inspirados pelos mesmos mistérios que o nosso maluco beleza e pilotando um IBM 704, parecido com o Dodge Polara daquele, o psicólogo e papa da inteligência artificial Frank Rosenblatt criou o Perceptron (1957): o primeiro modelo aplicado de neurônio artificial, de fato dotado da capacidade de aprender.

Para quem acredita que uma imagem que vale por mil palavras, segue uma foto do modelo 1957 da geringonça da IBM: https://bit.ly/2WUBdzs. E aqui, para efeitos de comparação, o Dodginho do rei do rock, no dia em que foi atropelado por uma onda: https://youtu.be/Z8WvET6pJOM.

O neurônio de Rosenblatt é composto de uma entrada, uma camada interna de processamento que se altera pela relação com o mundo e uma saída. Com simpatia dá para dizer que emula o funcionamento de células nervosas simples. Uma única célula, em contraste com a Aplysia, uma espécie de lula que utilizamos bastante para efeitos didáticos e que possui 20.000 neurônios, ou o cérebro humano, que possui cerca de 90Bi.

As coisas pareciam ir de bem a melhor no campo da inteligência artificial e muitas das questões que estão em alta hoje, como a substituição do trabalho humano por máquinas, acaloravam os debates intelectuais, etílicos e, como sempre foi mais comum, a irreplicável combinação de ambos.

*

O que muita gente não vislumbrava é a complexidade global do desafio, intimamente dependente da evolução geral dos hardwares, da matemática e da psicologia cognitiva.

O caso é semelhante ao da biologia molecular, onde Watson e Crick descreveram o DNA (1953), na expectativa de que dali em diante tudo iria mudar, apenas para notarem que, com sorte em cem anos, curas relevantes a partir da manipulação do mesmo poderão se tornar o novo normal.

E assim é que uma grande nuvem de desânimo e ausência de financiamento baixou sobre o campo da inteligência artificial, mais ou menos como depois baixou sobre a genômica, explicando o porquê de tanta demora até a tão sonhada cura do câncer.

No caso da primeira, o estopim foi a publicação de um relatório profundamente crítico à inteligência artificial, ou "aprendizado de máquina" para usar um termo bem mais direto ao ponto. Este relatório (1973) deu origem a uma acalorada discussão, que passou na televisão da época e pode ser revista aqui: https://bit.ly/2YZVHZt.

Pois bem, durante mais ou menos 25 anos – o mesmo quarto de século que viu o surgimento dos computadores pessoais, dos celulares, da Microsoft, Apple, Amazon e mesmo do Google – o aprendizado de máquina permaneceu um tema marginal, quase tabu, mais ou menos como o biohacking é hoje em dia, a despeito do fato de que também deverá explodir em algumas décadas, queiramos ou não.

*

Toda história de perdas é também de oportunidades, especialmente para quem aguenta o tranco. Um desses caras é o psicólogo cognitivo Geoffrey Hinton que, junto com dois outros cientistas responsáveis por moldar a realidade social atual, descreveu uma nova modalidade de rede neural, denominada back-propagation (para quem se interessar, o artigo seminal pode ser acessado aqui: https://www.nature.com/articles/323533a0), lançando a semente de uma nova onda para o campo, atualmente conhecida como deep learning.

Deep learning aproxima-se muito mais do cérebro humano, na medida em que conecta diversas camadas de neurônios entre aquilo que chega do mundo e a resposta que a máquina oferece ao mesmo. Considerando que cada neurônio é um espacinho limitado para a formatação do pensamento, pode-se dizer que essas redes têm milhões de vezes mais área para percorrer até o precipício das conclusões.

Para se ter uma ideia do quanto evoluímos desde o Perceptron, hoje existem redes neurais artificiais com 60M de neurônios (para quem quiser conhecer o método responsável por tal avanço, aqui vai: https://www.nature.com/articles/s41467-018-04316-3) e já se sabe que em breve teremos algumas com mais neurônios do que o próprio cérebro humano.

*

Essas redes têm esse tamanho todo para poderem dar sentido a matizes, nuances e combinações, o que por sua vez depende de quantidades enormes de dados. Nesse ponto, são bem diferentes da gente, especialmente sob um conceito: eficiência.

Muita gente pensa que quando uma empresa quer saber sobre o seu perfil está simplesmente expressando seu afã de lhe vender algo. Em geral, não é tão simples. Os dados tendem a servir primariamente ao treinamento de redes neurais do tipo deep learning, que irão aprender contigo como se relacionar com pessoas "parecidas com você", nas mais variadas situações, especialmente naquelas que sequer existem hoje. Isso é o que explica porque muitas empresas declaram que os dados serão anonimizados, preservando a sua identidade pessoal. A despeito de existirem falcatruas, é comum que seja isso mesmo, já que um cérebro artificial suficientemente bem treinado saberá tirar o máximo da relação, na ocasião apropriada.

O mesmo vale para diagnósticos clínicos, prevenção de catástrofes ou massagem. Sim, com aquele toque mais leve e prolongado nos pontos de dor crônica, exceto às segundas e quartas de manhã, quando as sessões têm que ser mais rapidinhas.

Este paradigma oculto aos olhos de muitos tem mais relevância na vida social e econômica do planeta do que praticamente qualquer outro. Não importa onde você vá ou o que você faça, seja no mundo digital ou fora dele, existe ou existirá alguém querendo coletar dados capazes de alimentar um cérebro dedicado a aprimorar sua capacidade de interagir com pessoas "parecidas com você".

Antes da revolução da inteligência artificial propriamente dita, devemos passar pela fase da "opulência de dados", como propus chamar este momento histórico peculiar, em que a ineficiência nos assombra, gerando doses cavalares de poluição computacional. Dezenas de campos sem utilidade alguma para a gente, que mesmo assim devemos preencher para avançar, cookies e mais cookies que devemos reter a revelia de nosso desejo de navegar rápido, cinco mil versões de "como você avalia meu serviço?" e assim por diante.

É claro que não se trata de poluição facilmente visualizável como tal, mas de algo parecido com os patinetes (em dois anos) ou as bicicletas (agora) que poluem o espaço público quando são abandonadas em qualquer canto, sem que necessariamente vejamos a coisa por esse ângulo.

Em contrapartida, esses protótipos todos que foram desenvolvidas da metade do século XX em diante tornaram-se utilizáveis, o que definitivamente não é pouca coisa.

*

Pois o esforço científico por trás deste feito acabou de ser coroado com a Turing Award, o Nobel da Computação, que nesta edição saiu para o supramencionado Geoffrey Hinton e dois colegas mais novos, Yoshua Bengio e Yann LeCun.

O prêmio é dado pela Association for Computer Machinery (ACM), da qual faço parte, para os cientistas computacionais mais relevantes do planeta. É mais ou menos como o Nobel, com a diferença de que o valor (US1M) é subsidiado empresarialmente, papel que cabe ao Google desde 2014.

Em 2017 o prêmio foi para John Hennessy e David Andrew Patterson. O primeiro é o presidente do conselho da Alphabet (holding controladora do Google) e o segundo "engenheiro com distinção" do mesmo. Em relação aos ganhadores deste ano, vale notar que apenas Patterson não é ligado à empresa. Isso não significa que o prêmio seja enviesado, mas serve de indicativo do quanto o Google anda empenhado em arregimentar os maiores cientistas computacionais do mundo e, em especial, do quanto aposta no aprendizado de máquina como futuro da computação e da própria vida em sociedade.

Em parte pelo entusiasmo das grandes corporações, em parte pelos resultados impressionantes atingidos pelo deep learning nas mais diversas áreas, tornou-se hegemônica a ideia de que este poderá nos levar a um novo patamar de relacionamento com as máquinas, em que estas serão capazes de mimetizar abordagens tipicamente humanas da realidade e estabelecer relacionamentos fluidos conosco.

Na minha opinião, a ideia está errada.

*

Entre todos os grandes nomes da ciência cognitiva que seguem vivos, nenhum é mais famoso e respeitado do que Noam Chomsky. Antes de receber o apelido de pai da linguística, Chomsky (1956) desenvolveu uma descrição de hierarquias simbólicas que o colocou no mais alto patamar da ciência computação (quem quiser ler seu artigo mais famoso sobre o tema, só acessar aqui: https://chomsky.info/wp-content/uploads/195609-.pdf). O que esse trabalho demonstra é que o efeito fluido e generalizante que o aprendizado de máquina persegue através do deep learning depende daquelas mesmas regras que levaram à cassação da licença para clinicar da Eliza.

Do ponto de vista biológico, isso está correto. É ponto passivo que nossa capacidade de pensar jamais poderia ter evoluído sem que o código neural tivesse incorporado o tratamento hierárquico de símbolos e algumas outras regras, que atualmente dormem em gramáticas e só são discutidas a fundo nos departamentos de linguística.

As versões do início de 2019 de assistentes virtuais como a Alexia e o Assistente do Google (os dois melhores) estão longe da capacidade de acompanhar uma verdadeira conversa, por carecerem destes princípios. Sua dificuldade está diretamente relacionada à demanda por quantidades avassaladoras de dados, em contraste com o que se aplica às crianças, que são capazes entender coisas bem mais complexas, mesmo que tenham se desenvolvido em ambientes de franca pobreza de estímulos.

Isso não significa que a linguagem com que falamos seja o código com que pensamos, ou ainda que as máquinas do futuro deverão inscrever aquela em suas redes. Na realidade, nossa compreensão do mundo é definida a partir da combinação de símbolos, premio turinafetos, cheiros e outras coisas mais, tal como se o cérebro fosse um grande espaço criativo e a gente tivesse um passe quase livre para explorá-lo.

*

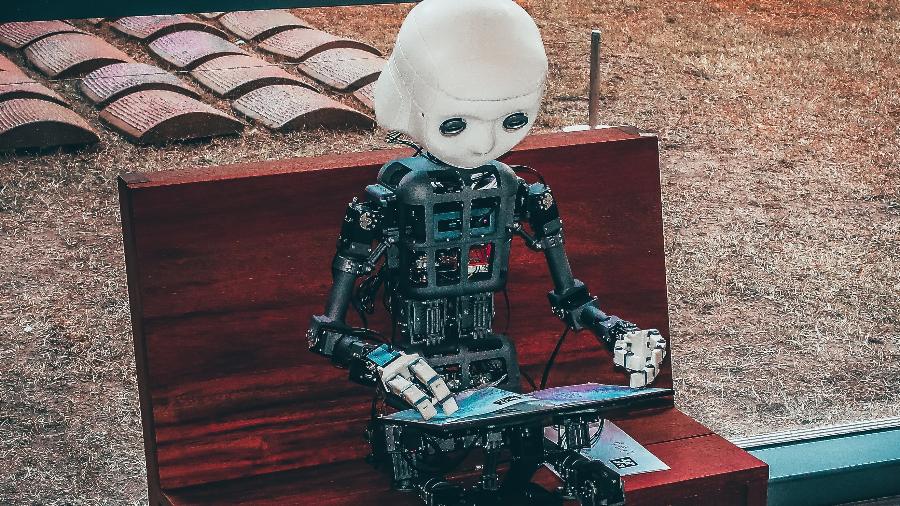

Assim sendo, deixo aqui minha previsão. O próximo grande salto tecnológico será dado pela combinação dos princípios selvagens do deep learning com alternativas mais especializadas, formando um novo tipo de inteligência, mais parecida com aquela que emerge do espaço criativo em que gozamos nosso passe quase livre. Tal avanço necessariamente envolverá a incorporação de códigos neurais inspirados nas dinâmicas linguísticas do cérebro, aproximando ainda mais a neurologia sintética da nossa.

Porém, antes disso, será necessário repaginar a Eliza. E dar-lhe um Prêmio Nobel.

ID: {{comments.info.id}}

URL: {{comments.info.url}}

Ocorreu um erro ao carregar os comentários.

Por favor, tente novamente mais tarde.

{{comments.total}} Comentário

{{comments.total}} Comentários

Seja o primeiro a comentar

Essa discussão está encerrada

Não é possivel enviar novos comentários.

Essa área é exclusiva para você, assinante, ler e comentar.

Só assinantes do UOL podem comentar

Ainda não é assinante? Assine já.

Se você já é assinante do UOL, faça seu login.

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Reserve um tempo para ler as Regras de Uso para comentários.